ロボットカーはトロッコ問題を解けるか?

2015年 科技 Google 人工知能 車

Googleのロボットカー(自動運転車/ドライバーレスカー)は、期待したほど高性能じゃないらしい。

Googleがロボットカーの開発を進めていて、プロトタイプが48万キロを走行したというニュースを見たのは2012年。「未来は今!」と興奮したことを覚えている。あれから3年経ったが、ロボットカーはまだ開発途上で、実用化はうんと先だった。

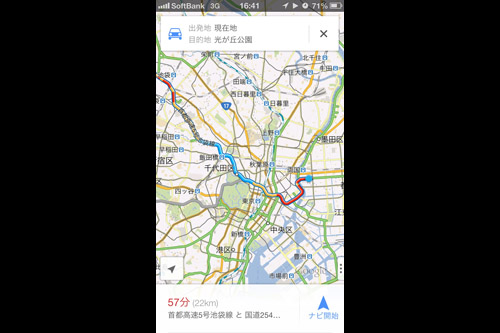

Googleのロボットカー

雨や雪を障害物と認識してしまうとか、人間の動きを予想できないとか、技術的な問題が多いけど、それらを解決しても法的、倫理的な問題(無理解)にぶち当たるだろうな。たとえばトロッコ問題である。

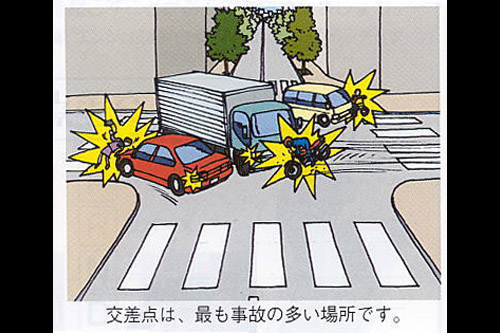

トロッコ問題

制御不能になったトロッコが走ってきた。放っておけば、前方にいる5人の作業員が轢き殺される。あなたが分岐器のレバーを引けば、トロッコは別線路に入り、そこにいる1人の作業員が死ぬ。あなたはどう考えるか?

トロッコ問題 - Wikipedia

- 5人を助けるため1人を犠牲にしてもよい ... 功利主義

- 作為的に1人を殺すことは罪だから、なにもしない ... 義務論

- 5人の老人と、1人の子どもだったら? ... 寿命がある方が価値が高い?

- 5人の他人と、1人の知人だったら? ... 愛情は功利主義を越える?

- 5人の作業員と、正体不明のタンクだったら? ... 可能性をどこまで考える? フレーム問題。

- 自分が線路に飛び込んで、全員を救えるとしたら? ... 自己犠牲は正しいか?

- だれかを突き飛ばすことで5人救えるとしたら? ... 自分の手で殺人を行うとしたら?

こんな問題に、絶対の答えも、正しい解決方法もない。人間は全知全能じゃないから、まちがいも許容される。しかしロボットカーだったら?

ロボットの判断は客観的に改善できる

ロボットカーが事故を起こせば、そのときの状況や判断手順(アルゴリズム)が解析される。道徳的に納得出来ない点があれば、条件が追加されるだろう。たとえば、

- 乗員数が想定される被害者数より少ない場合は、自分自身を犠牲にせよ

- ただし乗員が大統領で、ガードマンが犠牲になる場合は無視せよ

- ただし大統領の変装をしたテロリストは例外とする

アルゴリズムが鍛えられていけば、ロボットカーが事故を起こしても、「まぁ、仕方ない」「最適な判断をした結果だろう」と認知されるんじゃないか?

道徳のアルゴリズム化である。

成功すれば、裁判官もロボットに任せられる。

実際にロボットが道徳判断できる必要はない。人間がアルゴリズムの点検が面倒になって、「もう任せていいや」と思えば、完成だ。おそらく副作用がこわくて、だれも編集できなくなる。

アイザック・アシモフ「災厄のとき」 - 「われはロボット」より 1950年

ロボットの陽電子脳が進化しすぎて、正しい判断をしたのかどうか、人間に把握できなくなった。どうしても必要なら、ロボットを解析するロボットを用意しなければならない。人間はこのまま、ロボットが言う「これが最適です」を信じていいのか?

ロボットカーの実用はまだまだ先だけど、未来が近づいているなぁと思う。